Umělá inteligence se rychle stává součástí našich mobilních zařízení. V čele tohoto trendu momentálně stojí společnosti Google a Samsung, ovšem ani Apple nezahálí a také usilovně pracuje na integraci AI do svých produktů. Nedávno cupertinská společnost představila projekt MM1, což je velký multimodální jazykový model (MLLM) schopný zpracovávat text i obrázky. Nyní byla zveřejněna nová studie, která odhaluje další pokrok v oblasti MLLM – model Ferret-UI zaměřený na pochopení mobilních uživatelských rozhraní.

Mohlo by vás zajímat

Studie publikovaná Cornell University představuje projekt s názvem Ferret-UI. Ferret-UI je nový MLLM navržený pro lepší porozumění displejům mobilních zařízení. Je vybaven řadou funkcí, které by teoreticky mohly umožnit to, že by Ferret-UI mohl pomohl Siri lépe rozumět vzhledu a funkčnosti aplikací a samotnému rozhraní operačního systému iOS. Studie zdůrazňuje, že i přes pokrok v oblasti MLLM mají mnohé modely problémy s porozuměním a interakcí s mobilními uživatelskými rozhraními. Mobilní displeje, často používané na výšku, představují pro AI jedinečnou výzvu kvůli hustému uspořádání ikon a textu.

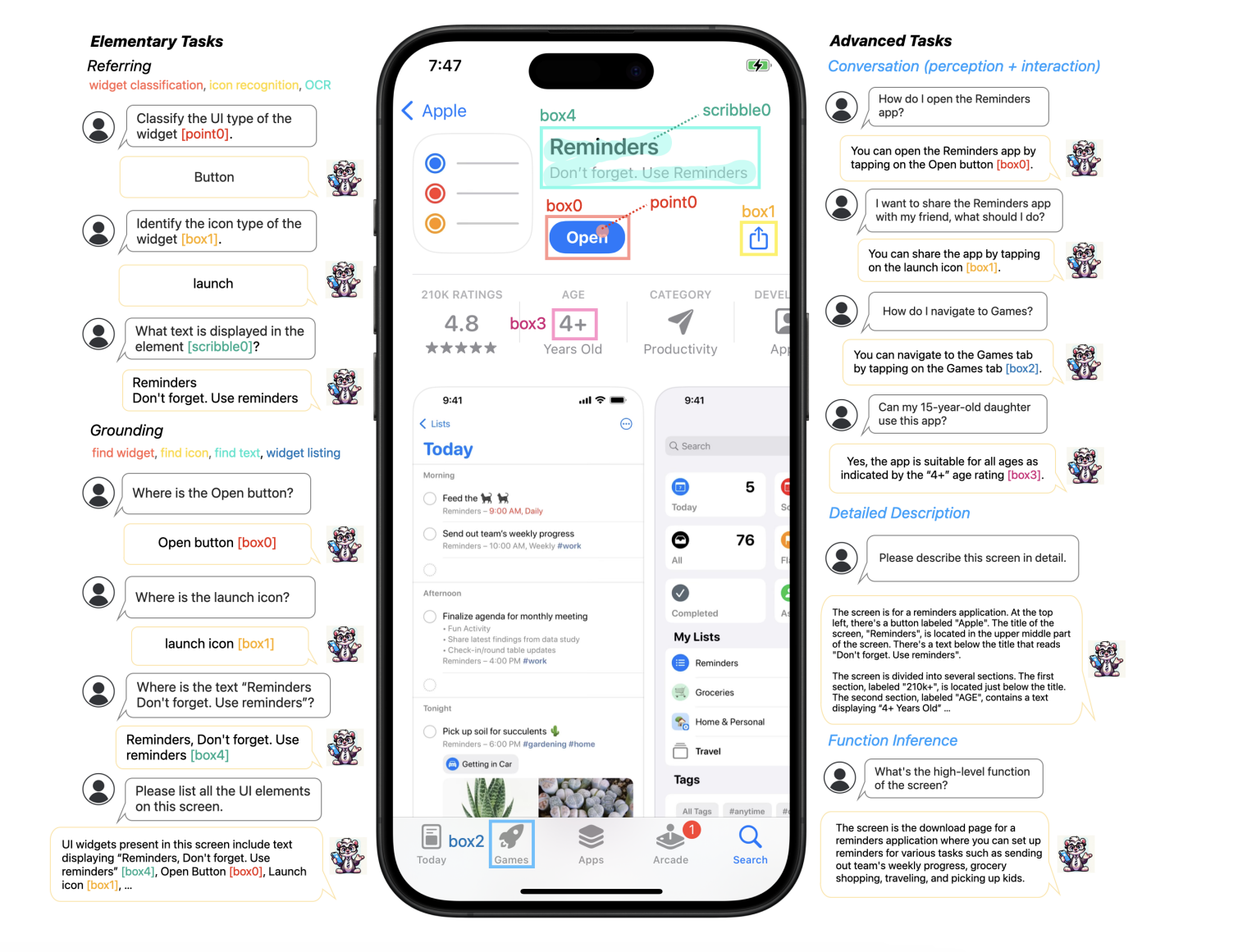

Aby se s tím Ferret-UI popasoval, zavádí funkci zvětšení, která zlepší čitelnost prvků na obrazovce zvětšením obrázků na požadované rozlišení. Tato schopnost zásadně mění interakci AI s mobilními rozhraními. Podle studie vyniká Ferret-UI v rozpoznávání a kategorizaci widgetů, ikon a textu na mobilních obrazovkách. Podporuje různé metody zadávání, jako je ukazování, ohraničování nebo skicování. Prostřednictvím těchto úloh získává model dobrou představu o vizuálních a prostorových datech, což mu pomáhá s vysokou přesností rozlišovat různé prvky uživatelského rozhraní.

Co Ferret-UI odlišuje od ostatních, je jeho schopnost pracovat přímo s daty surových pixelů obrazovky, čímž odpadá potřeba externích nástrojů pro detekci nebo souborů zobrazení obrazovky. Tento přístup výrazně zlepšuje interakci s jednotlivými obrazovkami a otevírá možnosti pro nové aplikace, jako je například zlepšení přístupnosti zařízení.

Zatímco není potvrzeno, zda bude Ferret-UI integrován do Siri nebo jiných služeb Apple, potenciální výhody jsou však bezesporu zajímavé. Ferret-UI by díky lepšímu porozumění mobilním uživatelským rozhraním pomocí multimodálního přístupu mohl výrazně zlepšit hlasové asistenty, jako je Siri, a to hned v několika ohledech. To by mohlo znamenat, že Siri se lépe naučí rozumět tomu, co uživatelé chtějí v aplikacích dělat, a možná by zvládla i složitější úkoly. Navíc by Siri mohla lépe pochopit kontext dotazů tím, že vezme v úvahu, co se nachází na displeji. To by nakonec mohlo vést k plynulejšímu používání jablečné hlasové asistentky, což by asistentovi umožnilo zvládat akce jako navigaci v aplikacích nebo porozumění tomu, co se na obrazovce vizuálně děje.